Nhận biết công nghệ lừa đảo Deepfake

Tại cuộc họp báo thường kỳ của Bộ Thông tin và Truyền thông (TTTT) ngày 5.5, ông Trần Quang Hưng - Phó Cục trưởng Cục An toàn thông tin - đã thông tin với báo chí về vấn nạn lừa đảo áp dụng công nghệ cao, đặc biệt là Deepfake.

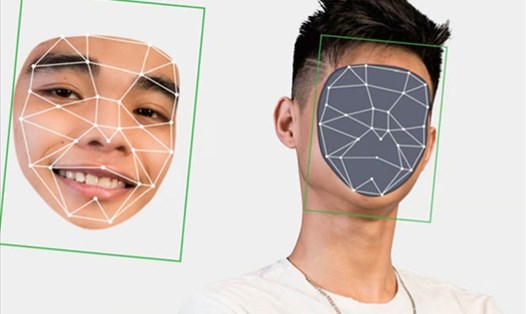

Theo ông Hưng, Deepfake là một dạng lừa đảo áp dụng công nghệ cao, khi các đối tượng sử dụng công nghệ trí tuệ nhân tạo (AI) để tạo ra những video hoặc hình ảnh giả, sao chép chân dung người khác để tạo ra các đoạn video giả dạng người thân, bạn bè để thực hiện các cuộc gọi lừa đảo trực tuyến.

Deepfake đang là một mối đe dọa đối với sự trung thực và tin cậy của video và hình ảnh.

Nó có thể được sử dụng không chỉ để lừa đảo trực tuyến mà còn sử dụng cho các mục đích khác như tấn công chính trị, tạo ra những tin tức giả mạo hoặc phá hoại danh tiếng của người khác.

Ông Hưng cho biết, phần lớn hình thức lừa đảo trực tuyến này nhắm tới việc lừa đảo tài chính. Đối với các cuộc gọi deepfake như hiện nay, vẫn có thể có một số dấu hiệu để nhận biết bằng mắt thường như thời gian gọi rất ngắn, kéo dài chỉ vài giây.

Cùng với đó, khuôn mặt của người bị giả mạo sẽ thiếu tính cảm xúc và khá "trơ" khi nói chuyện, hoặc tư thế của họ trông lúng túng, không tự nhiên, hoặc hướng đầu và cơ thể của người gọi trong video không nhất quán với nhau.

Ngoài ra, một số chi tiết khác dễ nhận biết như màu da của nhân vật trong video bất thường, ánh sáng kỳ lạ và bóng đổ không đúng vị trí cũng là dấu hiệu của một cuộc gọi Deepfake.

Vấn đề âm thanh cũng là một chi tiết nhận biết Deepfake trong cuộc gọi video. Âm thanh của Deepfake sẽ không đồng nhất với hình ảnh, có nhiều tiếng ồn bị lạc vào hoặc clip hay cuộc gọi sẽ không có âm thanh.

Không chỉ phân biệt bằng các dấu hiệu trên, người dùng mạng Internet có thể phân biệt Deepfake bằng một số chi tiết khác, chẳng hạn như tài khoản chuyển tiền không phải của người đang thực hiện cuộc gọi. Cùng với đó thường kẻ gian sẽ ngắt giữa chừng với lý do mất sóng, sóng yếu.

"Trong lúc chúng ta đang chờ giải pháp kỹ thuật để ngăn chặn triệt để được các hình thức lừa đảo như này thì rất cần các cơ quan truyền thông tuyên truyền rộng rãi tới người dân để có thể nắm bắt kịp thời các thông tin và thủ đoạn để đề phòng" - ông Hưng nói.

6 giải pháp giải quyết cuộc gọi rác

Cũng tại cuộc họp báo, ông Nguyễn Thành Phúc - Cục trưởng Cục Viễn thông - cho biết, thời gian vừa qua, dù các nhà mạng đã đẩy mạnh chuẩn hoá thông tin thuê bao, nhưng tình trạng cuộc gọi rác vẫn còn xảy ra và gây ảnh hưởng tới nhiều người dùng.

Trước thực trạng trên trên, ông Phúc cho hay, Bộ TTTT xác định có 6 biện pháp quan trọng để giải quyết tình trạng trên.

Thứ nhất, Bộ TTTT sẽ chỉ đạo doanh nghiệp viễn thông di động tiếp tục thực hiện chuẩn hoá thông tin thuê bao, xử lý tình trạng SIM có thông tin thuê bao không đúng quy định, hay còn gọi là sim rác. Sau đó, bộ sẽ thanh, kiểm tra để khắc phục tình trạng một thuê bao có nhiều SIM.

Thứ hai, tiếp tục phối hợp với cơ quan chức năng của Bộ Công an xử lý, bởi thẩm quyền xử lý các cuộc gọi lừa đảo, điều tra các trạm BTS giả cần được điều tra làm rõ và thẩm quyền này không thuộc về Bộ TTTT.

Thứ ba, Bộ TTTT sẽ đôn đốc kiểm tra, đánh giá việc xây dựng, triển khai các hệ thống chống, ngăn chặn cuộc gọi rác.

Thứ tư là thực hiện ngăn chặn, xử lý vi phạm gọi điện quảng cáo vào số điện thoại thuộc danh sách không quảng cáo.

Thứ năm, Bộ TTTT cũng sẽ đôn đốc kiểm tra ngăn chặn và thu hồi địa chỉ thực hiện cuộc gọi rác.

Cuối cùng, Bộ TTTT mong muốn đẩy mạnh tuyên truyền, nâng cao nhận thức của người dân để chống cuộc gọi rác, đồng thời không dễ dàng cung cấp thông tin cá nhân của mình trên môi trường mạng.

Ông Phúc nhấn mạnh, các biện pháp trên phải được thực hiện liên tục và kết hợp đôn đốc, triển khai đánh giá chống cuộc gọi rác thường xuyên, từ đó mới có thể góp phần hạn chế được cuộc gọi rác, cuộc gọi dịch vụ làm phiền người dùng.